laude Code é uma ferramenta de linha de comando criada pela Anthropic

A inteligência artificial está revolucionando o desenvolvimento de software, e as ferramentas de coding agentic representam o próximo grande salto nessa evolução.

Imagine ter um assistente de programação que não apenas sugere código, mas executa tarefas completas de desenvolvimento diretamente no seu terminal.

Agora imagine fazer tudo isso localmente, sem custos de API e com total privacidade dos seus dados.

É exatamente isso que conseguimos ao combinar Claude Code com Ollama, e neste artigo vamos ver exatamente como fazer isso!

Hospedagem Web Ilimitada A Partir De 12/Mês

Sua Hospedagem Compartilhada - A Melhor Hospedagem Web pelo melhor preço do Brasil

Claude Code é uma ferramenta de linha de comando criada pela Anthropic que funciona como um assistente de codificação com capacidades de agente: ele pode ler, modificar e até executar código no diretório de trabalho, tudo a partir do terminal.

Inicialmente, esse fluxo exigia conexão com os servidores da Anthropic, mas agora é possível apontar as chamadas do Claude Code para servidores compatíveis com a API Anthropic, como o Ollama.

Ollama é uma plataforma que permite executar LLMs (modelos grandes de linguagem) localmente: seja no seu laptop, desktop ou servidor, sem depender de provedores externos como OpenAI ou Anthropic.

A ideia é simples e poderosa: você baixa modelos open-source, como qwen3-coder, gpt-oss e outros, e roda tudo sem conexão com a internet.

Registro De Nome De Domínio A Partir R$ 79,89

São diversas extensões de Domínios ao seu gosto e preferencia, com Add-ons GRÁTIS em todos os nomes de domínio

Por que usar Claude Code com Ollama?

Usar Claude Code com Ollama é uma forma prática de ter um assistente de programação direto no terminal, rodando localmente, com mais privacidade, controle e previsibilidade de custo.

Em vez de depender de uma API na nuvem, você consegue apontar o Claude Code para um servidor local e trabalhar com modelos instalados na sua própria máquina, o que é ótimo para quem quer testar workflows com IA, proteger código sensível e manter autonomia no desenvolvimento, sem abrir mão da experiência de “pair programming” com um agente.

Rodar Claude Code com Ollama localmente é uma ótima opção se:

- Você quer manter seus dados e código privados.

- Não quer depender de custos com chamadas de API.

- Está trabalhando offline ou num ambiente isolado.

- Quer experimentar com modelos open-source e pipelines personalizados.

Hospedagem Grátis - Onde todos os webmasters começam por R$ GRATIS

1 GB Espaço em Disco, 1 Domínio, 1 endereço de e-mail, No Ads, 5 GB Tráfego E Suporte ao cliente...

Passo a passo

1. Instale o Ollama

O primeiro passo é instalar o Ollama no seu sistema (macOS, Linux ou Windows). A instalação é bem simples, mas caso queira ver um guia de como instalar, acesse o artigo Executando Modelos Localmente com Ollama.

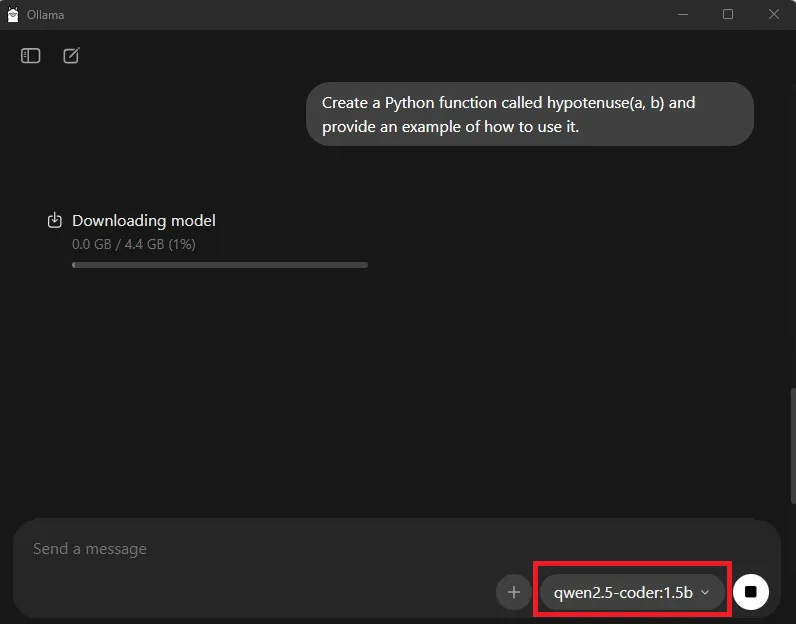

Agora, vamos baixar um modelo local. Você pode fazer isso pela interface gráfica, selecionando o modelo na combo e enviando uma pergunta a ele:

Ou por linha de comando:

ollama pull qwen2.5-coder:1.5b

Aqui, para fins de demonstração, vamos usar o modelo qwen2.5-coder:1.5b, mas você pode escolher outros se desejar (e se seu computador aguentar!).

Alguns modelos que funcionam muito bem com Claude:

- qwen3-coder

- glm-4.7

- gpt-oss:20b

O importante é o modelo ter suporte para tool calling!

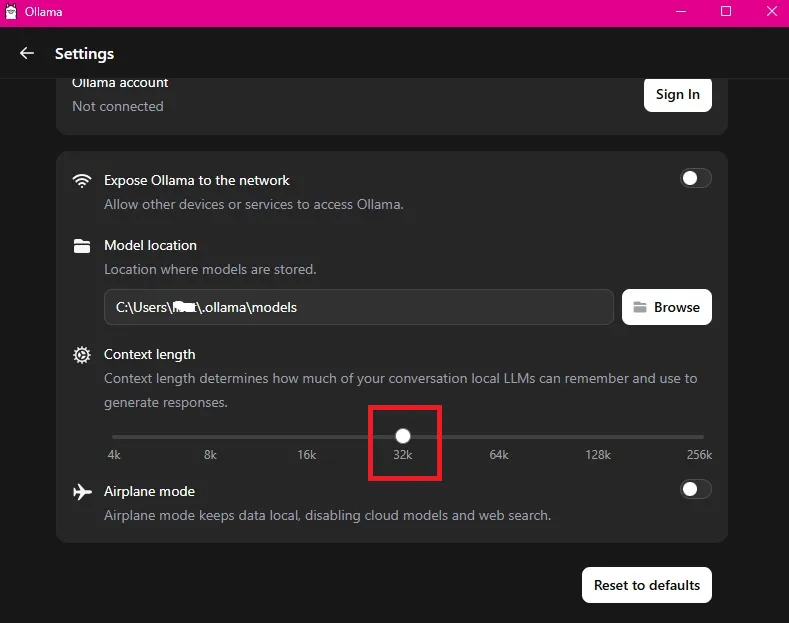

Vamos precisar também aumentar a janela de contexto do modelo. Nas configurações do Ollama, aumente para 32k.

Modelo de Jornal Pronto a partir 800,00

SÃO MODELOS PRONTOS EM SISTEMA JOOMLA E WORDPRESS OU A SUA ESCOLHA

2. Instale Claude Code

O Claude Code é um CLI separado que se comunica com uma API compatível com Anthropic. Para

instalar no Linux:

curl -fsSL https://claude.ai/install.sh | bash

Windows (via CMD):

curl -fsSL https://claude.ai/install.cmd -o install.cmd && install.cmd && del install.cmd

Windows (via Power Shell):

irm https://claude.ai/install.ps1 | iex

Agora, vamos configurar as variáveis de ambiente:

Linux:

export ANTHROPIC_AUTH_TOKEN=ollama

export ANTHROPIC_BASE_URL=http://localhost:11434

Windows:

set ANTHROPIC_AUTH_TOKEN=ollama

set ANTHROPIC_BASE_URL=http://localhost:11434

Windows (via Power Shell):

$env:ANTHROPIC_AUTH_TOKEN="ollama"

$env:ANTHROPIC_BASE_URL="http://localhost:11434"

Modelo de RádioWeb E TVWeb Pronto a partir de R$800,00

SÃO MODELOS DE FACIL GERENCIAMENTO DE TVWEB E RADIOWEB

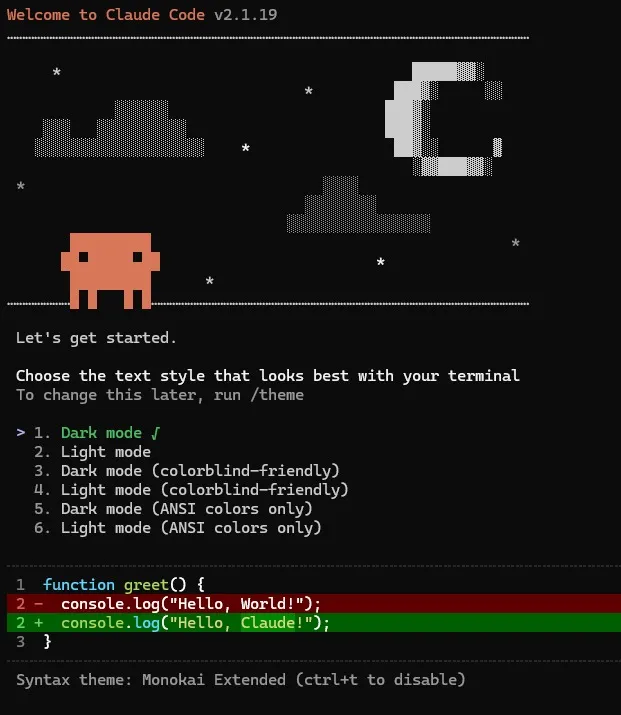

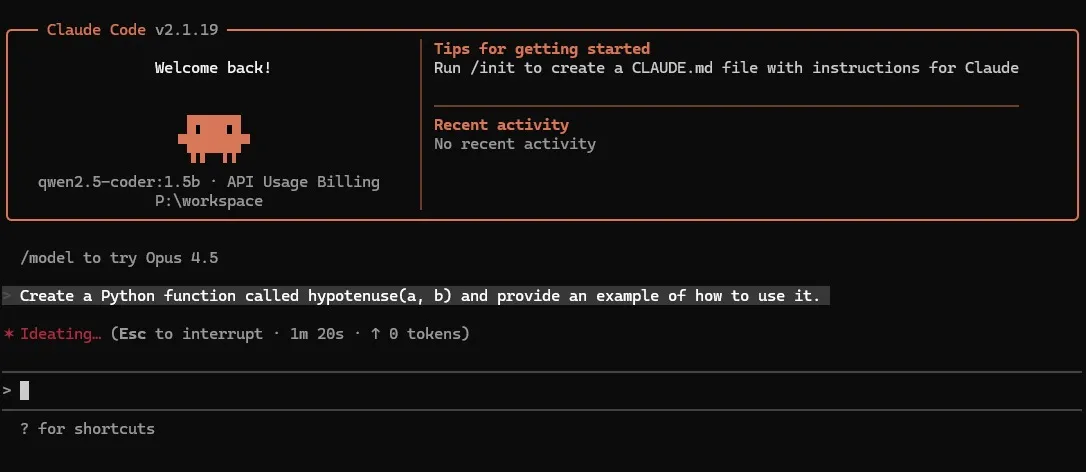

3. Executando Claude Code

Agora vamos executar nosso Claude Code! Basta enviar o comando:

claude --model qwen2.5-coder:1.5b

OBS: Se você está usando Windows e ele não encontrou o comando claude, mesmo após você reiniciando o CMD, tente assim:

C:\Users\<seu usuario>\.local\bin\claude.exe --model qwen2.5-coder:1.5b

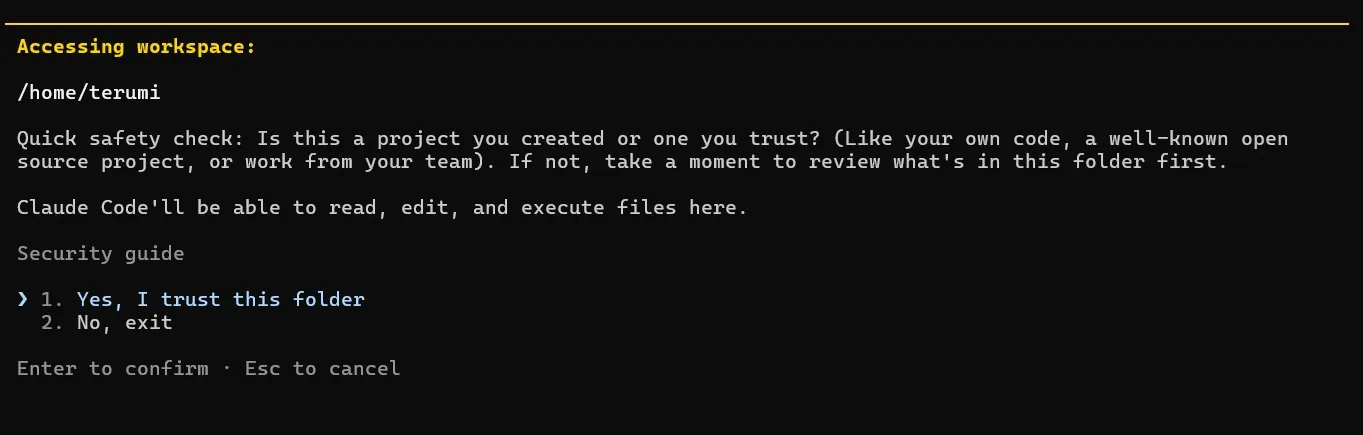

E pronto!! O Claude Code está rodando na sua máquina!

Selecione o estilo que você deseja e aperte ENTER. Confirme que você confia na aplicação:

Agora já podemos enviar nossos comandos para o Claude Code!!

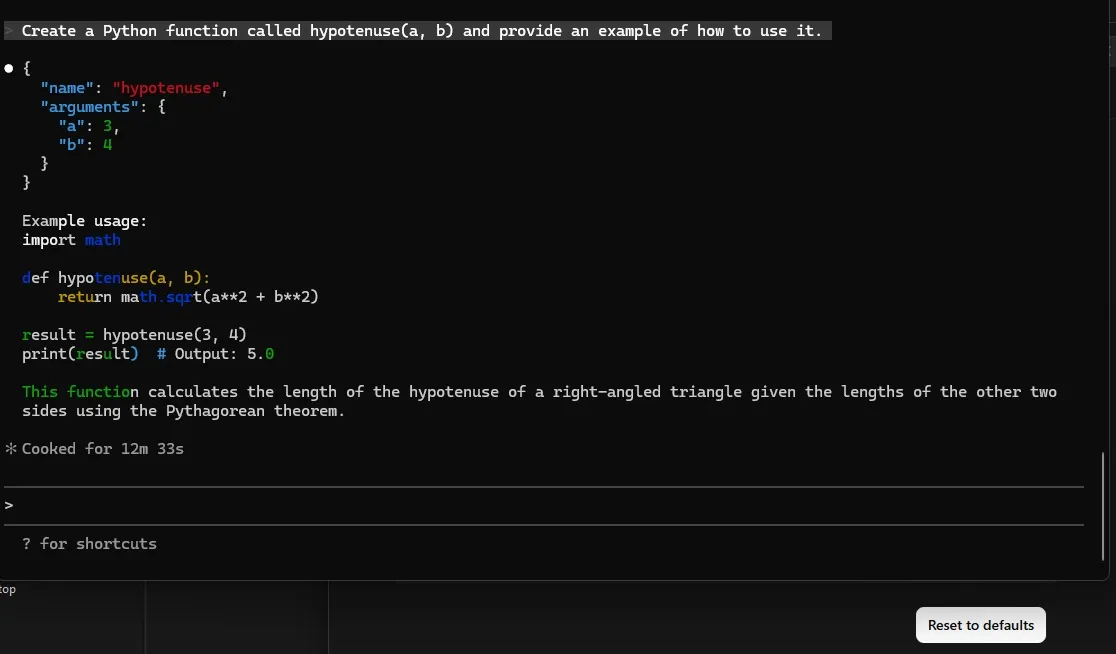

Podemos usar o Claude Code para várias tarefas, como criar funções, refatorar código, revisar partes do projeto, entre outros - e tudo isso sem enviar seus dados para a nuvem.

No nosso exemplo, vamos pedir para ele criar uma função que calcula a hipotenusa de um triângulo:

Aqui demorou vários minutos, mas saiu o resultado:

Pronto!! Ele devolveu o resultado!

Limitações

- Existem algumas coisas a considerar:

- Capacidade do hardware: modelos grandes podem exigir GPU poderosa ou muita RAM.

- Qualidade do modelo: modelos open-source podem não ser tão fortes quanto os proprietários da Anthropic.

Conclusão

Com a compatibilidade entre Claude Code e a API do Ollama, rodar assistentes de codificação diretamente na nossa máquina local ficou mais simples e poderoso do que nunca.

O fluxo combina o modelo agente de codificação do Claude Code com a flexibilidade dos modelos locais no Ollama: uma combinação ideal para quem quer controle, privacidade e autonomia no seu desenvolvimento com IA!

SÃO DIVERSOS MODELOS PARA SEU BLOSPOT A SEU GOSTO

por MBS Multimídia e Tecnologia - elisaterumi.

0 Comentários